Tous nos articles pour apprendre la photo

Apprendre la photo

Suivez le guide ou choisissez par ou vous voulez commencer ! Que vous souhaitiez apprendre les bases de la photographie, découvrir de nouvelles techniques ou encore savoir comment choisir votre matériel photo, nous avons un article pour vous :

Boostez votre apprentissage

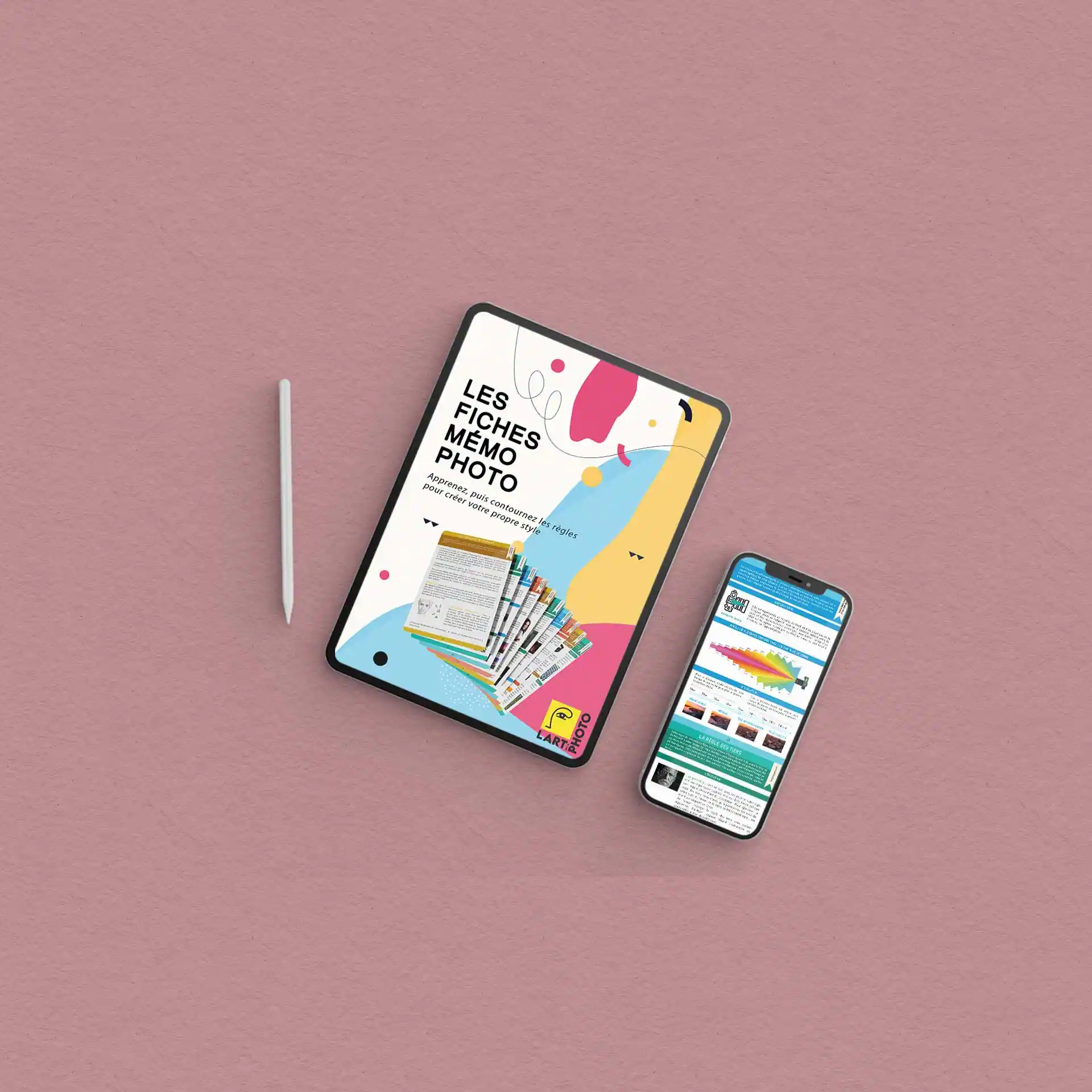

Les Fiches Mémo Photo

N’attendez plus pour révéler le photographe qui est en vous !

Comprendre & utiliser son appareil

Les bases essentielles pour comprendre et maitriser votre appareil photo.

Les piliers de la photographie

Ouverture, Vitesse d'obturation, sensibilité ISO n'auront plus de secret pour vous. Vous serez capable de choisir et d'utiliser les différents modes de votre appareil.

Composer avec brio

Comprendre comment composer votre image pour retranscrire en image votre vision.

Guides pratiques & techniques avancées

Prêt à passer au niveau supérieur ? Explorez différents types de photographie : longue exposition, photo de portrait, photo de nuit...

Vous souhaitez apprendre la photographie ? Quelques conseils pour les photographes débutants

Comment apprendre la photographie : Maîtriser les bases pour devenir un bon photographe

Si vous êtes un photographe débutant, il est important d’apprendre les bases de la photographie. Cela vous aidera à comprendre comment fonctionne votre appareil photo et comment vous pouvez utiliser le matériel photo pour prendre de belles photos. Prenez le temps d’apprendre les bases de la photographie et de les maitriser avant de passer à des choses plus avancées. Pour cela, consultez notre rubrique « Les bases de la photographie ».

Utiliser le bon matériel photo : Les indispensables pour photographier comme un pro et choisir son appareil photo

Le choix de votre appareil photo est également très important. Il existe plusieurs types d’appareils photo, comme les reflex et les hybrides qui sont plus avancés et offrent plus de réglages, tandis que les compacts sont plus simples et plus faciles à utiliser. Pour bien choisir, vous pouvez consulter notre rubrique « choisir son matériel photo ».

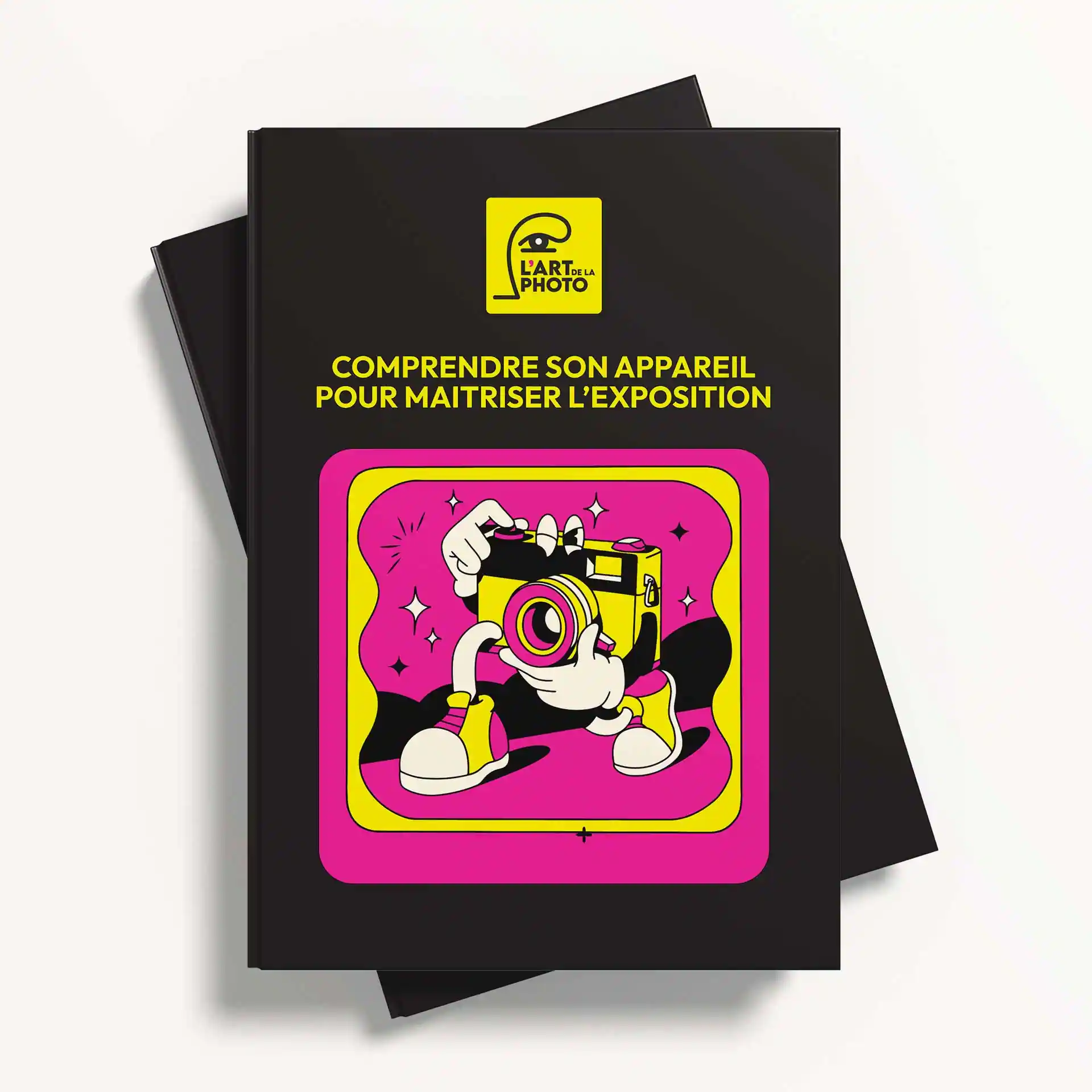

Prenez le temps d'apprendre la photo : Les clés pour réussir vos prises de vue

Une fois que vous avez choisi votre appareil photo, il est temps d’apprendre à l’utiliser. Prenez le temps de lire le manuel d’utilisation et de comprendre comment fonctionne votre appareil photo. Apprenez à utiliser les différents réglages pour obtenir la meilleure prise de vue possible. N’oubliez pas que le matériel photo est un outil important pour le photographe, il est donc essentiel de bien le comprendre. Pour comprendre et maitriser les principaux réglages de votre appareil, vous pouvez télécharger notre ebook gratuit : « Comprendre son appareil et maitriser l’exposition » ci-dessus.

Apprendre la photo pour créer de belles images

Pour faire de belles photos, vous devez apprendre à maitriser la technique de la prise de vue. Cela implique de comprendre la focale, la profondeur de champ et les réglages de votre appareil photo. La focale détermine la distance entre l’objectif et le capteur de votre appareil photo, tandis que la profondeur de champ détermine la zone de netteté de votre photo. Apprendre à maitriser ces éléments vous aidera à faire de belles photos.

Booster son apprentissage et Photographier comme un pro : Les astuces d'un photographe expérimenté

Si vous souhaitez progresser plus rapidement, les FICHES MEMO PHOTO sont faites pour vous. Elles regroupent l’essentiel des thèmes à maitriser quand on apprend la photo et elles sont classées par groupes pour s’y retrouver facilement. Les FICHES MÉMO sont également illustrées pour un apprentissage visuel efficace.

Devenir un photographe accompli : Comment maitriser l'art de la photographie

Une fois les bases maitrisées, vous trouverez dans la section « les techniques avancées » un ensemble d’articles dédiés à des pratiques photos plus pointues. Vous retrouverez notamment des guides pratiques sur la photo pose longue, la photo de rue ou encore la photo noire et blanc…